基于自主研发的NE-D163A 主控SoC人工智能视觉芯片,肇观电子今日面向机器人、安防、AR/VR、无感智能门禁、机器视觉、物联网、智能交通(客流统计)等行业推出内嵌AI智能深度相机Feynman系列,提供SDK,赋能客户部署差异化算法,支持客户深度定制,以满足各种智能设备定位、避障和智能分析等需求。Feynman系列深度相机的主控芯片内嵌几何和深度引擎DEP,AI加速引擎NPU与视觉加速引擎DSP,采用主动双目视觉技术,在室内外各种场景,均能生成高帧率和高精度的深度图,同时支持端侧实时智能AI算法的部署。整机具有深度图精度高、帧率高、AI算力强、ISP成像质量好、集成度高、功耗低、体积小等诸多优点。

▲ 内嵌AI的智能深度相机Feynman M1

Feynman相机搭载了散斑结构光、双目红外摄像头IR模组、彩色摄像头RGB全局曝光模组以及惯性测量单元 (IMU)。这些丰富的传感器组合提供了多维度的信息,使得Feynman相机能够帮助机器人构建强大的环境感知和理解能力。

▲ Feynman M1 结构图

01. Feynman深度相机的卓越性能

由于Feynman相机自带1.2Tops INT8 / 0.6Tops FP16 NPU(Neural Processing Unit)和666 DMIPS DSP(Digital Signal Processor)视觉加速算力,因此,在产生深度图的同时可以基于RGB图像或者深度图完成物体识别、检测和智能分析等功能。进而,利用DSP加速视觉算子,相机可定制实现高性能的深度图后处理,点云处理,以及对VSLAM算法关键函数的加速。这是目前业界唯一一款内嵌AI和DSP扩展算力的深度相机。

▲ Feynman M1 Depth+CNN演示效果

深度距离的精确程度取决于深度图的精度。Feynman相机具有强大的深度视觉处理能力,它无需外挂其他处理器,就可以产生性能高达720P 30FPS的深度图,且具有极低的空洞率。实测数据表明,在同一物品和同一光照条件的情况下,某国际巨头R* D435 的空洞率在1%附近,Feynman空洞率为0.2%。

▲ Feynman M1深度图效果

Feynman的深度图具有90°对角的广角视场,可以帮助智能设备看得更广,实现更好的避障和路径规划。下图可以看出,Feynman所看到的场景比常规深度相机看到的视野更宽广。

▲ 市面常规相机深度图58°*45°(左)vs Feynman M1深度图84°*60°(右)

Feynman相机内置的NE-D163A芯片还具有业内创新的自学习ISP流水线架构,从而在各种复杂光照环境下均能获得优质的图像。Feynman相机传感器支持极高动态的HDR,并且在低照度场景下依然能清晰成像。

▲ 不同光照环境下的图像处理对比图

在与市场上高端3D深度相机的性能指标进行比较之后(下表),可以看出Feynman 3D+AI深度相机的竞争优势,尤其在智能方面的亮点更加突出。相机的结构非常紧凑,尺寸为89.8mm x 25mm x 30.8mm,和市面主流深度相机的大小兼容。

▲ 某国际巨头R* D435 (左)与Feynman M1 (右)

性能参数 | 某国际巨头R* D435 | NextVPU Feynman M1 |

深度图精度@测量范围 | 2%@0.2-2m | 2%@0.1-3.0m |

深度图像 | Up to 480p@90fps | Up to 480p@100fps |

深度FOV | 87°*58° | 84°*60° |

深度环境适用场景 | 室内,室外 | 室内,室外 |

阳光下空洞率高 | 阳光下低空洞率 |

RGB图像 | 卷帘曝光 | 全局曝光 |

端侧扩展算力 | 不支持 | 1.2T NPU |

666 DMIPS DSP |

IMU | 不支持 | 9DoF |

接口 | USB3.0 | USB3.0 |

以太网(扩展款) |

电源及数据航插(扩展款) |

防水防尘 | 不支持 | IP54 |

环境温度 | 0~35℃ | -10~65℃ |

▲ 某国际巨头R* D435 vs Feynman M1性能参数比较

机器人、安防、AR/VR、无感智能门禁、机器视觉、物联网、智能交通

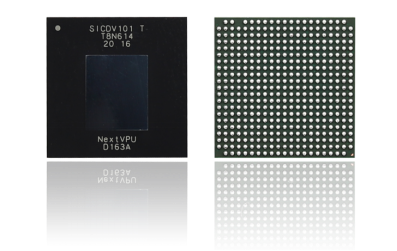

02. 主控SoC AI 视觉芯片 NE-D163A

这颗主控SoC芯片NE-D163A是由肇观电子自主研发,拥有高性能深度视觉处理独立硬件IP,专门应用于机器人、AR/VR、工业检测等领域的芯片,已在客户产品中通过了人脸支付、活体检测的BCTC增强级认证。下表是芯片的各项参数:

▲ NE-D163A 视觉AI芯片

▲肇观电子视觉AI芯片NE-D163A参数

NE-D163A 包含的NPU具有业界领先的硬件利用率。根据每TOPS下对典型网络的推理帧率,NE-D163A的性能比业界其它AI芯片相比要高2-3倍。其自带的AI编译器Infer Studio™ 支持Caffe,Tensorflow,NCNN,ONNX等框架以及CNN,RNN,LSTM,Transformer等网络类型。同时,NE-D163A的NPU重点支持FP16和INT8两种精度类型,FP16精度无损、INT8精度损失在1%以内,提供了更高的算法部署的准确度。

▲ 不同芯片跑几种经典网络模型每秒处理的图片帧数对比

测试网络 | 网络大小 | PC NCNN fp32训练

精度(公开数据) | 部署至NE-D163A的

INT8精度 |

|

GoogleNet _V1/

Inception v1 | 224x224x3 | top 1= 0.661 | top_1= 0.653 |

top 5=0.884 | top_5= 0.886 |

mobilenetv1 | 224x224x3 | top_1= 0.698 | top_1= 0.695 |

top_5= 0.904 | top_5= 0.903 |

mobilenetv2 | 224x224x3 | top_1= 0.713 | top_1= 0.711 |

top_5=0.895 | top_5= 0.892 |

resnet18 | 224x224x3 | top_1= 0.664 | top_1= 0.670 |

top_5=0.889 | top_5= 0.886 |

resnet50 | 224x224x3 | top_1= 0.743 | top_1=0.743 |

top_5= 0.926 | top_5= 0.921 |

SENet-R50 | 224x224x3 | top_1= 0.760 | top_1=0.763 |

top_5= 0.936 | top_5=0.935 |

squeezenet_ v1.1 | 227x227x3 | top_1= 0.577 | top_1= 0.577 |

top_5= 0.796 | top_5= 0.798 |

▲经典网络模型在PC端和NE-D163A芯片上推理结果的精度实测对比,精度损失在1%以内

03. Feynman深度相机的应用场景

Feynman相机不仅适用于室内,场景复杂的室外仍然适用,在阳光下也可以获得好的深度图。市面上常见的深度相机,其主动光在太阳光下容易受到干扰,从而无法获得良好的深度图。Feynman相机采用独特的光学设计,在室外阳光下应用时,能在降低太阳光干扰的同时,保持信噪比,从而保证深度图的准确性和完整性。

▲ Feynman M1室外阳光下深度图

除了在机器人领域的广泛应用,Feynman相机也在工业场景有诸多应用,针对工业场景,Feynman提供了具有千兆以太网,电源和控制信号航插的扩展款。

▲ Feynman M1扩展款

04. 易于开发者二次开发

Feynman出厂自带标定参数,支持固件升级。为了方便开发者快速评测和集成,肇观电子还提供了丰富的软件工具和SDK支持:

主机端SDK源码,包括Windows/Ubuntu(ROS)/Android平台的SDK支持。该SDK用于主机访问和控制相机设备端,代码开源在Github和Gitee上面。对于需要利用端侧AI和DSP算力的产品和深度定制的客户,Feynman提供了设备端SDK。

▲ 各平台SDK支持

Feynman Viewer是Windows应用,可以通过USB接口进行相机访问,实时控制相机,并完成各类图像获取及展示等功能。

▲ Feynman Viewer 应用程序界面

Feynman符合人眼安全相关认证标准 IEC60825 Class I,IEC62471,防尘防水等级IP54,通过了第三方可靠性及EMC相关测试。

▲ Feynman 红外激光人眼安全等级

05. 结语

肇观电子结合自身的高性能芯片研发能力,3D视觉能力和系统整合能力,推出具有大广角、高帧率、高精度的Feynman 3D+AI 相机来满足各种智能设备定位、避障和智能分析等需求。另外一方面,由于消耗大量计算力视觉计算的任务转移到Feynman相机里面来完成,智能设备对外围芯片的算力需求随之降低,因而厂商可以选择低成本的外围芯片,这有助于降低智能设备的整体硬件成本。

近年来,伴随工业 4.0、人工智能、机器人等产业的蓬勃发展,3D视觉感知成为了限制目前包括机器人、安防、AR/VR、无感智能门禁、机器视觉、物联网、智能交通等众多领域发展的瓶颈,深度相机的需求迅速增长。尤其在移动服务机器人行业,包括送餐机器人、酒店服务机器人,商场机器人,巡检机器人、工厂AGV自主移动机器人、特种移动机器人等,机器人厂商不断寻求性能卓越,可靠,价格合适的深度相机。目前,Feynman系列相机已在诸多机器人产品中批量商用。